Apple Spatial Audio Format (ASAF) Plugins für Pro Tools Download

Inhalt

Brauchst du Hilfe mit ASAF? Schaue doch mal hier!

Apples neue Spatial-Audio-Tools wirken auf den ersten Blick ausgereift, aber jeder, der damit echte Inhalte produzieren will, merkt die Lücken sofort: instabile Exporte, fehlendes Headtracking, chaotisches Verhalten von Objekten und Szenen, APAC-Fehler und keine klaren Vorgaben für Vision Pro oder Quest 3.

Wenn du statt Tagen voller Trial-and-Error Frust einen Workflow willst, der wirklich funktioniert: Hier bekommst du professionelle Unterstützung.

Warum braucht es ASAF und nicht Dolby Atmos

Ich habe mir die neuen Apple Spatial Audio Plugins für Pro Tools angeschaut:

Die Veröffentlichung dieser neuen Plugins und Formate wurde als News im Rahmen der WWDC 2025 von Apple in Cupertino präsentiert.

Das ist ein erster Eindruck ohne Kopfhörer und ohne Headset. Es geht nur darum, was in der Box steckt, wie man damit anfängt und welche Funktionen mir sofort aufgefallen sind.

Ich habe ein Projekt in der Pipeline, bei dem ich mit Apple Spatial Audio mischen soll. Dort werde ich tiefer eintauchen und mit echtem Material experimentieren.

Heute zeige ich, warum ich neugierig bin, wie ich mich durch die Oberfläche bewege und was die einzelnen Module machen.

Apple hat diese Plugins offiziell veröffentlicht: Einfach hier klicken

Beim Installieren gibt es sofort mehrere hilfreiche Dinge. Es gibt Tutorialvideos, darunter eine rund vierzigminütige Gesamtübersicht.

Diese Videos und Beispielinhalte zeigen anschaulich, wie das neue Spatial Audio Format in der Praxis funktioniert und welche Möglichkeiten bei der Erstellung immersiver Inhalte bestehen.

Es gibt außerdem einen Videoplayer, der für die Arbeit mit 360 Grad und 180 Grad Material spannend ist. Es gibt Hinweise zu Export und Installation. Ich möchte herausfinden, wie gut sich das für echte Mischungen eignet und wo ich im Alltag Geschwindigkeit gewinne.

Wie man die Plugins herunterlädt

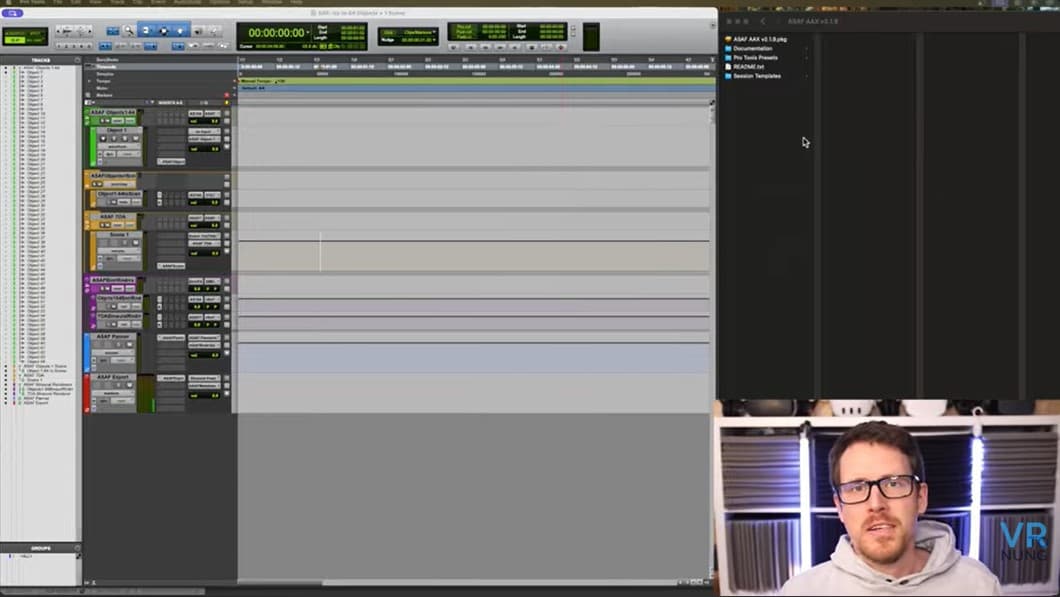

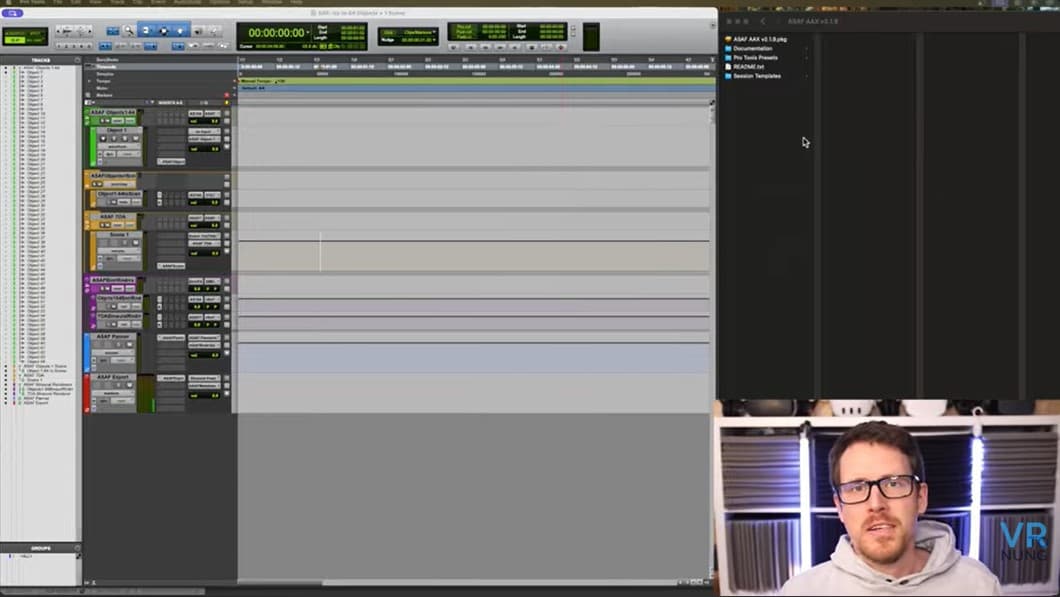

Ich lade die Plugins von der Apple Homepage und öffne in Pro Tools eine der mitgelieferten Session Templates. Es gibt Pro Tools Presets und Sessionvorlagen.

Die Vorlage lässt sich bis zu 256 Objekte hochziehen. Auch professionelle Tools wie DaVinci Resolve Studio können für die Bearbeitung und Erstellung von hochwertigen, immersiven Audioinhalten im ASAF-Format genutzt werden.

Im Rahmen der WWDC 2025 wurden das neue Spatial Audio Format ASAF und der Apple Positional Audio Codec (APAC) als innovative Technik und Standard für immersive Audioinhalte vorgestellt.

Dieses Audio Format basiert auf fortschrittlicher Technik und setzt neue Maßstäbe im Vergleich zur Konkurrenz wie Dolby Atmos.

Die capabilities der ASAF-Plugins unterstützen gezielt die Produktion und Optimierung immersiver Audio-Tracks, indem sie spezielle Funktionen für das Erstellen und Mischen von Spatial Audio bereitstellen.

Das Spatial Audio Format ASAF und der APAC Codec werden als Standard für immersive Inhalte auf verschiedenen Betriebssystemen wie iOS, macOS, tvOS und visionOS unterstützt, während watchOS ausgeschlossen bleibt.

PCM wird als technischer Bestandteil für die Audioverarbeitung genutzt. Die Kompatibilität des Formats hängt von der jeweiligen Jahreszahl und den Versionen der Betriebssysteme ab, die jährlich aktualisiert werden.

Entwickler und Hersteller wie Apple und Co. erzielen mit dem neuen ASAF und APAC beeindruckende Ergebnisse, insbesondere in Games, AR-Anwendungen und auf dem Mixed Reality Headset Vision Pro.

Die Einrichtung in Pro Tools ist wie gewohnt etwas eigen, weil man über siebte Ordnung Ambisonics und Busse geht. Man kann nicht einfach eine beliebige Busgröße festlegen.

Das ist nicht wie in Reaper. In der Vorlage sind schon mehrere Objekte angelegt und in Routing Ordner geführt. Ich gehe Schritt für Schritt vor und beginne mit Objekt eins.

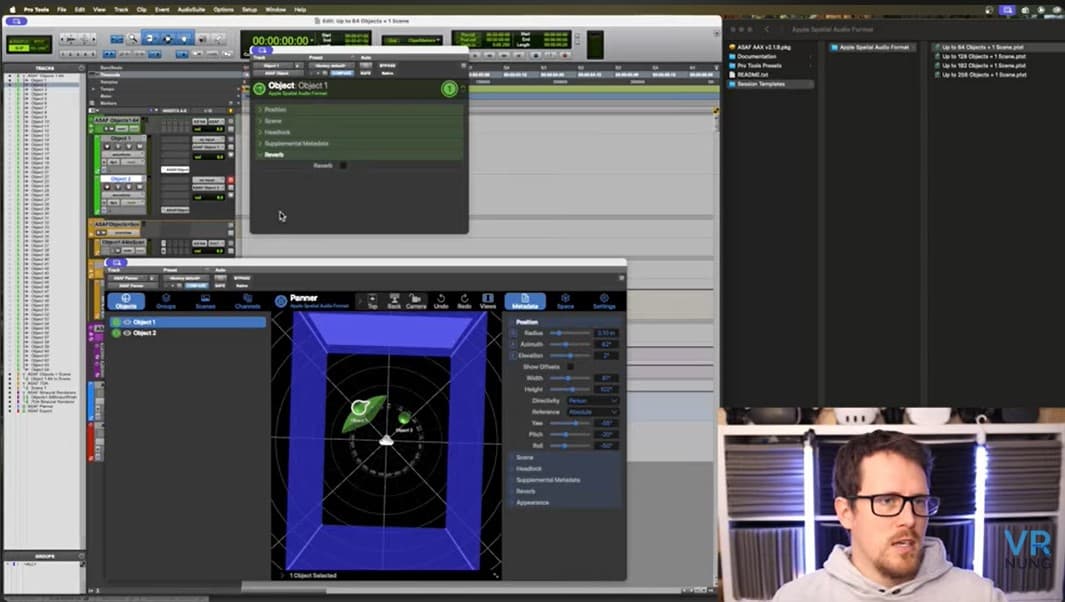

Was der Objekt Panner kann

Die Koordinaten sind sphärisch. Es gibt Azimut, Radius und Elevation. Der Radius verhält sich praktisch wie die Distanz. Breite und Höhe lassen sich setzen.

Die Position und Drehung der Klangobjekte im Raum können flexibel angepasst werden, um ein immersives 3D-Sound-Erlebnis zu schaffen. Die Objektposition ist entscheidend für die realistische Platzierung von Klangquellen im dreidimensionalen Raum und ermöglicht eine präzise Lokalisierung der Sounds.

Dabei wird die Kopfposition des Nutzers sowie die Ausrichtung zur Stirn erfasst, sodass der Sound dynamisch auf jede Bewegung reagiert. Die Position des Hörers beeinflusst maßgeblich die Wahrnehmung des räumlichen Klangs, da das System die Klangwiedergabe kontinuierlich an die aktuelle Position des Hörers anpasst.

So entsteht ein immersives 3D-Erlebnis, bei dem Klänge präzise um den Hörer herum positioniert werden und eine realistische räumliche Wahrnehmung ermöglichen.

Zusätzlich lässt sich die Lautstärke der einzelnen Klangobjekte individuell steuern.

Die Visualisierung zeigt die Veränderungen, auch wenn nicht immer sofort klar ist, was genau dargestellt wird.

Ich habe zusätzlich das große Bedienfeld, das als ASF Panel bezeichnet wird, geöffnet. Wenn ich den Azimut im Objekt ändere, sehe ich die Bewegung im großen Panner.

Mit mehreren aktivierten Objekten kann ich sie gemeinsam bewegen. Manchmal hakt das Pannen kurz, aber es ist unkritisch.

Direktivität auf Objektebene

Es gibt jetzt Direktivität. Das erinnert an die späten Funktionen aus der Facebook 360 Welt, geht hier aber weiter.

Man kann zwischen Person, Sänger und Studiomonitor umschalten. Das verändert, wie der Klang sich im Raum verhält. Höhere Frequenzen haben mehr Direktivität, Bässe sind ohnehin schwer zu orten.

Für Objekt eins wähle ich zum Test die Vorgabe Person. Ich kann einstellen, aus welcher Richtung die Person spricht.

Ich kann Achsen für Ausrichtung anpassen und zwischen absoluten und originbasierten Einstellungen wechseln. Origin bedeutet, dass die Ausrichtung zur Mitte zeigt. Wenn mehrere Quellen in eine Richtung zeigen sollen, ist die andere Variante nützlich.

Headlock und Binaural

Es gibt Headlock. Ich sehe die Option, Headlocked Audio zu externalisieren oder nicht. Üblicherweise ist ein Headlock Stereotrack ohne Räumlichkeit. Hier lässt sich aber auch ein binaurales Signal als Headlock verarbeiten.

Man kann damit denselben räumlichen Effekt sowohl auf freie 3D Objekte als auch auf Headlock Elemente anwenden. Das erinnert an Möglichkeiten, die es in Dolby Atmos VR vor Jahren gab.

Zusätzlich gibt es ergänzende Metadaten wie Effects, Dialogue und Narration. Diese Tags sind später beim Export relevant, weil man einzelne Kategorien getrennt ausgeben kann.

Die Verwendung von Metadaten ist dabei essenziell, um die korrekte Wiedergabe und Verarbeitung immersiver Audioinhalte im Apple Spatial Audio Format sicherzustellen.

Reverb im Objekt und die Gruppenstruktur

In jedem Objekt lässt sich ein Reverb aktivieren und mischen. Man kann also direkt im Objekt Automation setzen und den Hallanteil steuern, statt über Sends zu gehen.

Hall und Echo werden dabei gezielt an die jeweilige virtuelle Umgebung angepasst, um einen natürlichen Sound und ein realistisches Klangerlebnis zu erzeugen.

Im großen Übersichtsfenster sehe ich die Objekte, kann sie gruppieren, Gruppen aktivieren und deaktivieren und zwischen Objekten, Gruppen und Szenen umschalten.

Szene und Szenenrenderer

Es gibt einen Szenenworkflow. Man kann Objekte in eine Szene konvertieren und Raumdarstellung hinzufügen. Szene ist ein Konzept von Apple Spatial Audio, das Szenen und Objekte kombiniert.

Der Szenenworkflow wurde speziell für immersive Inhalte in AR- und Mixed-Reality-Umgebungen auf Geräten wie dem Apple Vision Pro und unter visionOS entwickelt, um die Möglichkeiten von 3D Sound in Verbindung mit einem Mixed Reality Headset optimal zu nutzen.

Wie sich beides genau zueinander verhält, sehe ich mir später tiefer an. Der Szenenrenderer nimmt sechs bis vierundsechzig Objekte und wandelt sie in eine Szene.

Die Kameraansichten lassen sich umschalten. Obenansicht, Rückansicht und weitere Perspektiven sind schnell erreichbar.

Ich kann das Sichtfeld, die Rotation, die Elevation und den Raum einstellen. Die Einstellungen für FOV, Raum, Materialien und VR-Modi sind entscheidend, um immersive Inhalte individuell anzupassen und zu optimieren.

Materialien sind auswählbar. Die Einstellungen erinnern an Umsetzungen in DaVinci Resolve, wo Apple Spatial Audio Funktionen bereits integriert sind. Man kann zwischen Movie und Music wählen.

Man kann von sphärischer auf kartesische Darstellung umstellen. Es gibt Modi für Virtual Reality, Virtual Reality mit Lautsprechern und Virtual Reality mit Kopfhörern.

Headtracking und HRTF

Es gibt eine Kopfansicht mit Neigen, Drehen und Zentrieren. Ich kann Headtracking aktivieren und verschiedene Tracker nutzen.

AirPods mit Headtracking sind möglich. Headphones spielen dabei eine zentrale Rolle, da sie in Kombination mit Headtracking und Spatial Audio Formaten wie Apple Spatial Audio ein besonders immersives, räumliches Klangerlebnis ermöglichen.

Es gibt OSC für offene Tracker. Die HRTF Auswahl ist vorhanden. Man kann die Apple System HRTF nutzen oder eine personalisierte Datei laden.

Szenenmodul, Filter und Visualizer

Im Szenenmodul finde ich Funktionen, die Ambisonics Nutzer kennen. Siebte Ordnung Ambisonics ist möglich. Es gibt Metadaten und Gains.

Besonders interessant ist ein räumlicher Filter, der Bereiche gezielt verstärken oder dämpfen kann. Ich kann den Filter frei positionieren und auch rechteckige Fenster nutzen. Mehrere Filter lassen sich kombinieren.

Es gibt Spiegelungen und Umschalter für vorne und hinten sowie oben und unten. Die gesamte Szene lässt sich rotieren. Es gibt einen Visualizer, der sich über das Bild legen lässt. In meinem kurzen Test hat er aber nicht sofort funktioniert.

Videoplayer und Overlay

Der neue Videoplayer lässt sich direkt öffnen. Ich kann ein 360 Grad Video per Drag and Drop laden. Das Video lässt sich rotieren. Das hilft bei gedrehtem Material oder veränderter Ausrichtung.

Das Sichtfeld lässt sich ändern. Damit kann man den Blick für 180 Grad Anwendungen zuschneiden. Ich sehe keine direkte Option für 3D stereoskopisches Video. Im Objekt Overlay kann ich Panning vornehmen, die Deckkraft steuern und Achsen sperren. Mehrfachauswahl ist möglich.

Raster und Zusatzinfos lassen sich ein und ausschalten. Es gibt Bildkonvertierungseinstellungen. Sobald ein Video geladen ist, erscheint ein Timecode, und die Wiedergabe kann mit der Session synchronisiert werden oder mit Versatz angepasst werden.

Die Playback-Funktion ist dabei entscheidend für die nahtlose Wiedergabe und Steuerung immersiver Audio- und Videoinhalte, insbesondere um eine präzise Synchronisation und hochwertige Wiedergabe im Apple Spatial Audio Format zu gewährleisten.

Objektrenderer für Wiedergabe

Der Objektrenderer bündelt alle Objekte und rendert sie. Es gibt Stereo für Lautsprecher und Binaural für Kopfhörer. Für Mehrkanal fehlt eine einfache Presetauswahl. Man kann ein benutzerdefiniertes Layout anlegen und die Dokumentation für die Konfiguration heranziehen.

Gängige Formate wie Fünf Punkt Eins oder Sieben Punkt Eins Punkt Vier sind nicht als direkte Presets vorhanden. Die Einstellungen sind möglich, aber erfordern Handarbeit.

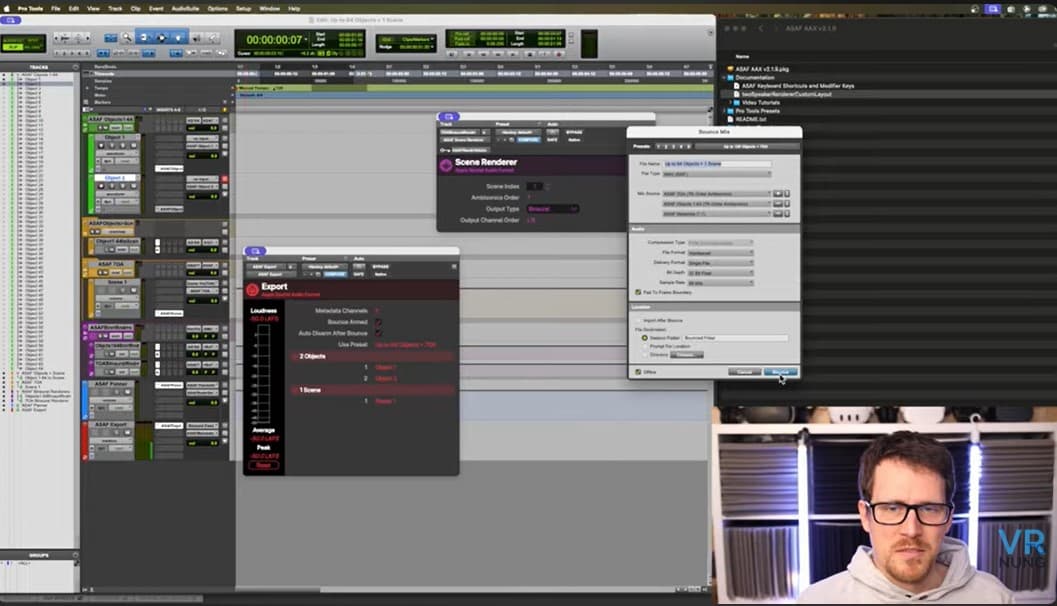

Export und Zusammenführen mit Video

Der Export funktioniert über eine markierte Zeitauswahl. Ich markiere die Objekte für den Bounce. Es gibt Presets für erste Ordnung, für viele Objekte bis hin zu siebter Ordnung.

Nach dem Bounce öffnet sich ein Fenster zum Konvertieren. Am Ende erhalte ich eine MP4 Datei, die speziell für Delivery Purposes optimiert ist und eine optimale Wiedergabe auf verschiedenen Plattformen ermöglicht.

Diese Datei lässt sich mit dem Video zusammenführen, sodass ein räumliches Video mit räumlichem Audio entsteht. Mir fehlt ein Encoder mit der Einfachheit des früheren Facebook 360 Encoders. Der aktuelle Apple Workflow wirkt weniger direkt. Für mich ist das im Moment umständlich.

Was ich als Nächstes mache

Dieser Überblick zeigt, was in den Plugins steckt. Die Werkzeuge wirken vielversprechend. Ich habe ein konkretes Projekt, in dem ich sie praktisch einsetze. Dann gibt es echte Hörbeispiele statt reinem Klicken.

Ich bin gespannt, welche Fragen auftreten und welche Funktionen in der Mischung wirklich Zeit sparen.

Für Rückmeldungen und Wünsche bin ich offen. Ich melde mich mit weiteren Einblicken, sobald ich im Projekt mit Material arbeite.

Als Möchtegern-Schriftsteller und Serien Geek freue ich mich besonders darauf, meine Leidenschaft für Medien und das Schreiben mit euch zu teilen.

Apple Spatial Audio Format – Experte hilft

Viele steigen in Apple Spatial Audio ein und merken sofort, dass Theorie und Praxis weit auseinanderliegen. Die offiziellen Plugins sind frisch, die Dokumentation ist lückenhaft, und der Workflow ändert sich gefühlt jede Woche.

Wer gerade versucht, ein Projekt zu starten, landet oft an denselben Stellen:

-

Export funktioniert nicht auf der Apple Vision Pro oder Quest 3

-

Davinci Resolve scheint die einzige Lösung für den ASAF.mp4 Workflow

-

Headtracking reagiert nicht mit Airpods oder OSC – Objekte, Szenen und Metadaten verhalten sich anders als erwartet.

-

APAC liefert Fehler ohne erklärbaren Grund.

-

ADM- oder Dolby Atmos-Workflows lassen sich nicht sauber übertragen.

Solche Situationen kosten Zeit, Nerven und sind in Deadlines kaum tragbar. Genau hier helfe ich: Ich richte funktionierende Workflows ein, kläre typische Missverständnisse auf und baue mit dir eine stabile Pipeline – von der Session bis zur finalen immersiven Datei.

Wenn du dir Support wünschst, der nicht bei Grundlagen stehen bleibt und dir den Umweg über endlose Tests erspart: Hier findest du 1:1-Unterstützung für Apple Spatial Audio Format. und drüber hinaus.